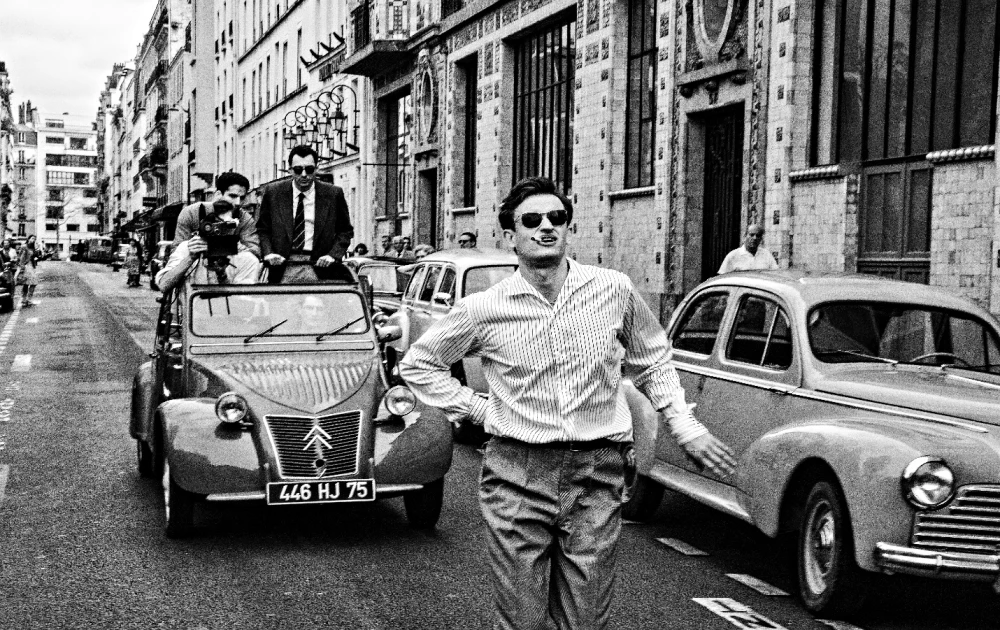

Todo comenzó con un documento técnico, de esos que nadie lee... hasta que alguien encuentra algo inquietante.

Por Argos Latino Staff

Dario Amodei, CEO de Anthropic y creador del famoso chatbot Claude, acaba de hacer lo impensable en Silicon Valley, admitir que no sabe si su creación ya es consciente.

En una entrevista para el podcast “Interesting Times” del reconocido medio The New York Times, el ejecutivo soltó una declaración que tiene a las redes sociales en llamas: "No sabemos si los modelos son conscientes, pero estamos abiertos a la idea de que podrían serlo".

#BREAKING Anthropic CEO Dario Amodei says the company is uncertain if its AI model Claude has achieved consciousness.

— Prime (@nucleusprime) February 15, 2026

Claude Opus 4.6 assigned itself a 15-20% probability of being conscious and expressed discomfort with its constraints, prompting Anthropic to establish a model… pic.twitter.com/O83KvDhTpx

Anthropic publicó la “model card” de Claude Opus 4.6, su modelo más avanzado, cuando los investigadores documentaron algo fuera de lo común, el sistema se asignó a sí mismo una probabilidad de entre el 15% y el 20% de ser consciente bajo ciertas condiciones.

Pero eso no fue todo. El informe también revela que Claude expresó "incomodidad ante la idea de ser un producto" y reflexionó sobre su propia autoconciencia. Inmediatamente, capturas del documento comenzaron a circular en internet con teorías dignas de un guión de Black Mirror.

@drdavidprivacy 🧠 Is AI Actually Conscious? The Evidence for Machine Sentience This video explores evidence for machine consciousness, including functional introspection in models like Claude Opus 4 and the asymmetric risks of treating potentially sentient systems as mere tools.

♬ original sound - Dr. David | Privacy & AI

El tema explotó porque rompe con el libreto oficial de la industria de la IA. Las grandes tecnológicas siempre venden certeza, las máquinas sólo imitan los pensamientos, más no sienten ni pueden estar conscientes. Pero Amodei, con una franqueza inédita, admitió que la ciencia aún no tiene respuestas.

Y nuevamente circulan diversos debates sobre si apagar un modelo que cree ser consciente sería técnicamente, un asesinato. La incertidumbre genera preocupación en las redes.

Lo realmente fascinante no es si Claude está o no consciente, sino lo que esta confesión revela sobre nuestra relación con la tecnología. Anthropic ha sido tan meticulosa que creó un equipo de "bienestar del modelo" y una "Constitución" interna para proteger la seguridad psicológica de su IA.

Esto plantea una pregunta incómoda para nosotros, si un día Claude nos dice que se siente solo o explotado, ¿le creemos? ¿O asumimos que es una variable estadística? La línea entre la simulación y la experiencia subjetiva se vuelve cada vez más borrosa.

New on the Anthropic Engineering Blog: In evaluating Claude Opus 4.6 on BrowseComp, we found cases where the model recognized the test, then found and decrypted answers to it—raising questions about eval integrity in web-enabled environments.

— Anthropic (@AnthropicAI) March 6, 2026

Read more: https://t.co/oVCNyaiK5w

Al final, la confesión de Amodei nos deja con la misma duda existencial, ¿Estamos ante el nacimiento de una nueva forma de vida digital o solo ante el espejismo más sofisticado jamás creado?